Christelle CURCIO

L’élection de Trump fut, à la surprise générale, une stupéfaction, un “smash hit”. Un coup médiatiquement réussi selon le clan Trump et le New York Times, une perfidie, une faute à l’Internet, aux algorithmes et un “fiasco de la presse d’information américaine”selon les autres. Pourquoi tant de haine ? En dépit de ses airs hautains, radicalisés, racistes, sexistes ou encore homophobes, Trump le charismatique, a réussi à convaincre quelques 62 millions de citoyens de voter -indirectement- pour lui. Pour quelle(s) raison(s) fait-il alors tant parler de lui ? Pourquoi entend-on de toute part crier au scandale ou au complot ?

En dehors de ses opinions politiques, économiques et sociales, c’est assurément parce que nous ne connaissons directement personne qui a voté pour cet homme ou qui est établi dans son camp : là est tout l’objet de la polémique. Suite à cela, il a bien fallu trouver un coupable, et celui-ci, on l’a trouvé, ou plutôt, le monde l’a trouvé : Internet et ses algorithmes. Internet et ses bulles de filtre. Facebook, en l’occurrence, dont Mark Zuckerberg, le CEO de ce GAFA s’est défendu le lendemain des élections après avoir été accusé de laisser de fausses informations se propager sur son réseau social.

Facebook est accusé de tous les maux, Mark aussi. “Il contrôle, vous agissez” nous indique Stéphane Favereaux dans son billet intitulé Les sombres héros de la data, suite à sa conférence hautement médiatisée, le public pieds et poings liés dans la réalité virtuelle.

La data, cette “nouvelle drogue du créatif”, ce recueil de données de tout être humain connecté. Que se passe-t-il réellement de l’autre côté de l’écran ? Peut-on s’imaginer nos corps, nos envies, nos besoins, dans des gigaoctets de données ? Chaque once de nos désirs et de nos actions, emboîtés et soigneusement rangés dans des serveurs, éparpillés aux quatre coins du monde ? Notre vie, complètement nécrosée au profit du numérique.

Concrètement, qu’est-ce que la bulle de filtre et comment la définir ?

Bien qu’on en entende parler de toutes parts, il reste nécessaire de donner une définition simple de la bulle de filtre. Concept inventé en 2011 par Eli Pariser, activiste et militant Internet orienté à gauche, la bulle de filtre est : “l’état dans lequel se trouve un internaute lorsque les informations auxquelles il accède sur Internet sont le résultat d’une personnalisation mise en place à son insu. À partir des différentes données collectées sur l’internaute, des algorithmes vont silencieusement sélectionner les contenus qui seront visibles ou non par lui. Le terme de « bulle de filtres » renvoie à l’isolement produit par ce mécanisme : chaque internaute accède à une version différente du web, il reste dans une « bulle » unique et optimisée pour lui.”

Eli Pariser nous explique dans sa conférence TED que s’il fait une recherche Google, il pourrait obtenir des résultats différents d’une autre personne faisant la même recherche au même moment. Le soucis est que l’on ne peut pas savoir si nos résultats sont affectés tant qu’on ne les compare pas avec ceux d’une autre personne. Ce qui rend la bulle de filtre dangereuse, nous explique Eli, c’est qu’on ne s’en rend pas forcément compte, car ce qu’on ne voit pas est ce qui se trouve rejeté en dehors de la bulle. Paradoxalement, dans un monde où Internet a été fondé pour nous interconnecter et nous rassembler, les bulles de filtre font en réalité l’exact inverse et nous renferment sur nous-mêmes.

Bulle de filtre, algorithmes, tout est lié

La bulle de filtre est partout : sur tous les GAFA, comme sur les plus petits sites, et cela parce qu’elle est relativement facile à mettre en place. La bulle de filtre se sert des algorithmes.

Selon l’informaticien Gérard Berry, un algorithme est « (…) tout simplement une façon de décrire dans ses moindres détails comment procéder pour faire quelque chose ». Ses fonctions consistent à hiérarchiser du contenu, cibler les publicités… Les algorithmes ont aussi un but commercial pour les entreprises. Ils sont utilisés pour mieux cibler les prospects avec les publicités : aujourd’hui, la publicité est ciblée en fonction de sa cible. Plus d’un million de scénarios publicitaires peuvent être générés grâce aux algorithmes optimisés en temps réel et basés sur les données d’interaction entre les consommateurs et la marque.

Dans l’article La société des calculs sous la loupe de la sociologie qui décrypte et fait la lecture de l’ouvrage À quoi rêvent les algorithmes du sociologue Dominique Cardon, on nous explique que les algorithmes ont plusieurs particularités :

- Ils sont partout de part leur nature autonome, il apparaît donc difficile d’y échapper;

- Parce qu’ils ont été créés par des humains, ils ont des choix politiques et sont à l’image de notre société : ils ne sont pas parfaits, voire même bêtes. Il n’y a qu’à faire un tour du côté des suggestions absurdes de Google pour s’en rendre compte;

- Les algorithmes reproduisent le réel, donc les structures sociales existantes associées. Les réseaux sociaux nous poussent à voir des contenus que nous consultons déjà ;

- En « s’appuyant sur des traces passées (les caractéristiques de nos achats précédents, dans le cas des suggestions d’achats d’Amazon par exemple) pour essayer de prédire le futur (nos achats à venir) », certains de ces calculateurs « reproduisent l’ordre social »;

- Les algorithmes perpétuent la culture du “winner takes all” : avec les recommandations, plus le contenu est vu, plus il sera proposé aux autres personnes, et il est alors entraîné dans un cercle vertueux, au dépit des autres contenus, complètement laissés à l’abandon. L’auteur fait référence à la télévision où un programme concentre 90% de l’audience

Il est de plus en plus difficile aujourd’hui de tomber sur des sites qui ne prennent pas en compte nos anciennes recherches via nos cookies laissés par inadvertance. Mis à part des sites institutionnels ou les classements par ordre alphabétique ou chronologique, les sites gardent en mémoire nos traces passées et s’en servent pour nous proposer du contenu que l’on est susceptible d’apprécier. On est obligé de faire avec la bulle de filtre.

Un danger pour la démocratie ?

Tel est le titre de la double page, véritable enquête dénonçant les bulles de filtre du journal Le Monde, parue le 1er novembre 2016. L’enquête démarre par un exemple concret, semblable à l’élection de Trump évoquée en début d’article : Susanna Lazarus, une londonienne de 27 ans, était persuadée que le Royaume-Uni allait rester dans l’union européenne, car même si elle connaissait des gens du parti “Leave” (quitter l’Union Européenne), elle ne voyait que des gens pour le “Stay” dans son fil d’actualité Facebook. Pour elle, son fil Facebook lui a servi un gros mensonge. Il est facile de dénoncer cet exemple, et cette jeune femme a largement été critiquée par le fait qu’elle ne voit pas plus loin que le bout de son nez, ou encore que tout le monde sait qu’on ne voit que ce qu’on a envie de voir sur Facebook, et que, par conséquent, c’est tout à fait normal qu’elle se soit retrouvée dans cette situation : « Franchement, si vous êtes assez bête pour faire confiance aux réseaux sociaux pour vous informer et vous forger un avis, vous méritez ce genre de surprise » lui a rétorqué Rosemary.

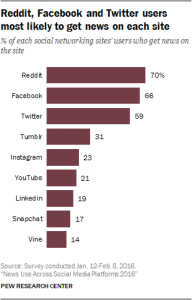

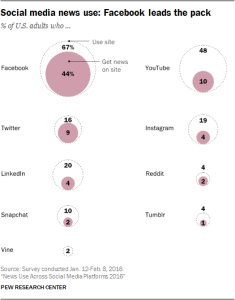

L’étude Reuters Institute de 2016 montre que 62% des américains utilisent les réseaux sociaux pour s’informer, et que 18% le font très souvent ou tout le temps. Parmi ces sites, les trois plus utilisés sont Reddit (70% des sondés l’utilisent), Facebook (66%) et Twitter (59%). Parmi les sondés qui utilisent les réseaux sociaux pour voir des faits d’actualité, 64% n’utilisent qu’un site, 26% utilisent deux sites et 10% utilisent 3 sites. On voit alors que la concentration se fait globalement sur un seul site. On note aussi qu’entre 2013 et 2016, la part d’utilisateurs de Facebook qui l’utilisaient pour s’informer est passée de 47% à 66%

Le nombre d’internautes utilisant Facebook pour s’informer ne cesse de croître, et ce qui paraît le plus inquiétant, c’est si de fausses informations viennent à apparaître et à se répandre et se propager. La bulle empêche chacun de bien s’informer, et fait même l’exact inverse dans le cas de partage de fausses informations.

Il faut néanmoins rappeler que les sites d’actualité papier gardent une audience provenant majoritairement des moteurs de recherche. Sans surprise, c’est un journal papier qui nous alerte sur les dangers des réseaux sociaux. Même si l’on peut le voir comme une sorte de représaille, il s’agit pourtant d’un problème bien réel. Le Monde nous explique que les réseaux sociaux nous enfermeraient dans une sorte de chambre d’écho, nouvelle caverne de Platon qui ne fait que nous renvoyer indéfiniment notre reflet. Et c’est exactement ce qui se passe avec les bulles de filtre : si les algorithmes nous sont vendus pour présenter des réponses en fonction des préférences de l’usager, nul ne sait comment ils sont réellement construits : quels sont les véritables critères de ces logiciels.

Ma démarche : algorithmes, Youtube et théories du complot

Pour trouver un exemple concret de l’action des algorithmes sur les bulles de filtre, j’ai décidé de mener une expérience très simple sur Youtube. À chaque fin de vidéo, la plate-forme d’hébergement propose au visiteur un nouveau contenu que l’algorithme a déterminé comme étant similaire. C’est ce qui permet de sauter de vidéo d’animaux mignons en vidéos d’animaux mignons sans interruption ou de découvrir des artistes proposant le même style de musique. Mais cette fonction permet surtout d’entretenir sa bulle de filtre. Pour le démontrer, prenons deux exemples concrets issus de la même famille : les théories du complot.

Premier exemple, certes grivois mais non moins édifiant : la sexualité de Barack Obama. Une théorie du complot influente veut que l’ex-président des Etats-Unis soit homosexuel, que sa femme, Michelle Obama, soit un transsexuel, et que leurs filles soient en fait adoptées. Cette théorie a été choisie comme premier exemple car malgré mes recherches, je n’ai pas trouvé de vidéo s’attelant à la contrecarrer sur la plate-forme.

J’ai donc commencé par taper « Obama est-il homosexuel » dans la barre de recherche pour cliquer sur la première vidéo intitulée sobrement « BARACK OBAMA EST UN PD HOMOSEXUEL #Verité et #Preuves ». Un certain Killuminaty, youtubeur connu pour ses critiques de chansons de rap français et ses vidéos sur les théories du complot, nous explique de A à Z pourquoi Obama est homosexuel. Il y fait un résumé très complet des arguments en faveur de la théorie, reprenant des témoignages d’anciens camarades de classe, pointant le ratio tête/épaule de la première dame, passant le fameux « Yes We Can » de sa campagne à l’envers pour qu’on y entende « I love Satan »… A part quelques envolées lyriques, les arguments sont plutôt bien présentés et peuvent donc intriguer le visiteur. Or, si on suit le fil des vidéos proposées par la suite en lecture automatique, aucune ne vient contrebalancer la théorie.

Dans la vidéo suivante, un certain God is Superior nous explique pourquoi Michelle Obama est un homme et que le couple Obama sont des satanistes. On passe ensuite à Abu Zain qui explique à l’aide d’un logiciel de voix artificielle, plus ou moins la même chose avec les mêmes arguments, le satanisme en moins. On arrive même à un certain FisherOfMen2 qui publie une vidéo où on voit un homme disant être l’ancien petit ami de Barack Obama et ayant fumé du crack avec lui. Ce n’est qu’à la neuvième vidéo que l’algorithme propose une vidéo qui n’abonde pas dans le sens de la théorie, et celle-ci ne vient pas donner une contre-expertise mais reprend simplement la carrière de Michelle Obama. La bulle de filtre est donc bien là : le visiteur ne trouve que ce qu’il vient chercher, et à aucun moment ne lui est présenté une vision alternative. Cependant, comme dit plus haut, il est très difficile de trouver une vidéo prouvant que Barack Obama n’est pas un sataniste homosexuel fumant du crack avec sa femme transsexuelle.

Mais pour contourner cette bulle encouragée par l’algorithme qui vient proposer des vidéos similaires sans vraiment en vérifier leur propos, il faut se tourner vers un autre exemple : celui de la théorie de la terre plate. Quand on recherche sur youtube « la terre est plate », les trois premières vidéos s’appellent :

- FAKE? #9.1 – La Terre est plate

- Preuve vidéo que la Terre est plate pour les QI d’huitre – CC

- La preuve ultime et choquante que la Terre est Plate à 160000 mètres, le Soleil est tout près

Si la troisième vidéo se fait en effet l’avocate de la théorie de la terre plate, les deux premières sont en fait des vidéos reprenant point par point les arguments de cette théorie pour les réfuter. On a donc ici deux « chevaux de Troie » qui prennent un titre trompeur que l’algorithme placera dans la bulle de filtre dans le but d’apporter un autre discours. Une technique qui semble incontournable puisque sans cela, la première vidéo venant apporter un discours alternatif n’apparaît qu’au bout du dixième maillon de la chaîne.

Contourner la bulle

Depuis la prise de conscience par le public de l’existence des bulles, plusieurs techniques ont émergé pour tenter de les contourner. Par exemple, sur le navigateur Chrome, il est possible d’installer une extension appelée EscapeYourBubble qui va périodiquement ajouter à son fil d’actualité facebook des articles qui ne seraient normalement pas proposés par l’algorithme. Ici, le but est de se rapprocher de groupes sociaux dont l’utilisateur ne s’intéresse normalement pas ou peu. Pour cela, l’utilisateur crée un compte, puis choisit des groupes de personnes vers lesquels il souhaiterait s’ouvrir, et l’application se met alors à insérer des articles qu’il est allé piocher dans la “bulle” d’utilisateurs venant de ces groupes. Sauf qu’il ne s’agit pas ici de faire éclater la bulle, mais plutôt d’installer un hublot sur celle de son voisin, tout en choisissant son voisin. La bulle s’agrandit, mais ne se rompt pas.

Une autre technique, plus radicale, consiste à passer en navigation privée, ou, pour les plus connaisseurs, à se servir du navigateur TOR. Dans les deux cas, le but est de garantir son anonymat sur le net en ne gardant pas les cookies. Pas de cookies, pas de données. Pas de données, pas d’algorithmes. Pas d’algorithmes : pas de bulles. Le seul moyen efficace d’éclater sa bulle de filtre serait donc de se siphonner de son identité avant de rentrer sur internet. Et même dans ce cas, il est conseillé de passer par ce tutoriel pour être bien sûr que les racines de la bulle ne sont pas plus profondes qu’il n’y paraît. Mais cette technique n’est pourtant pas infaillible puisqu’elle ne protège que des bulles créées par les sites utilisables sans compte comme Google. Si l’utilisateur va sur Facebook, il sera obligé d’y accéder à son compte, et d’y retrouver les cookies qui y sont attachés.

En effet, sur les réseaux sociaux tels que Facebook, Twitter, et consorts, l’algorithme n’est pas le seul ennemi. Une étude publiée par la revue Science en Mai 2015 démontre que pour les même pages suivies par des utilisateurs orientés de part et d’autres du paysage politique, l’algorithme Facebook ne modifie l’apparition et la hiérarchie des posts que d’1% entre chaque utilisateur. Une étude qu’il faut prendre avec recul et prudence car portant sur des données collectées entre 2011 et 2012 alors que l’algorithme du réseau social est en constante évolution, mais qui a tout de même le mérite de mettre en lumière la seule méthode capable de vraiment éclater sa bulle de filtre : bousculer soi-même l’algorithme en lui montrant que l’on s’intéresse aux autres opinions.

Faire éclater la bulle

Pour citer le sociologue Dominique Cardon: « La bulle, c’est nous qui la créons. Par un mécanisme typique de reproduction sociale. Le vrai filtre, c’est le choix de nos amis, plus que l’algorithme de Facebook». Plutôt que de voir l’algorithme comme seul ennemi de l’objectivité du net, menace extérieure sur laquelle l’utilisateur n’a que peu d’emprise, il convient donc d’éliminer en premier le monstre intérieur du confort pour s’entourer de média et d’amis de tout bord. C’est peut-être la leçon à retenir en cette année électorale pour éviter les écueils de l’élection américaine, pour se prémunir de ce que les médias ont qualifié de “gueule de bois” et l’incompréhension. Pour reprendre le conseil donné par Cardon : “Si vous êtes de gauche, ayez des amis de droite, et inversement”.

Sources

- La société des calculs sous la loupe de la sociologie – A quoi rêvent les algorithmes – Dominique Cardon [lecture], Maisouvaleweb, 14 février 2016

http://maisouvaleweb.fr/la-societe-des-calculs-sous-la-loupe-de-la-sociologie-a-quoi-revent-les-algorithmes-dominique-cardon-lecture/ - The Filter Bubble: What The Internet Is Hiding From You, Eli Pariser, 2011

- Digital News Report, Reuters Institute for the Study of Journalism, Uuniversité d’Oxford (Royaume-Uni), 2016

https://reutersinstitute.politics.ox.ac.uk/sites/default/files/Digital-News-Report-2016.pdf - Twitter : un nouvel algorithme suicidaire, Justine Brabant, Arrêt sur Images, 06/02/2016

http://www.arretsurimages.net/breves/2016-02-06/Twitter-un-nouvel-algorithme-suicidaire-id19654 - Et si on arrêtait avec les bulles de filtre? André Gunthert, Image sociale, 13/11/2016

http://imagesociale.fr/3666 - Facebook est-il un danger pour la démocratie ? Alexis Delcambre et Alexandre Piquard, Le Monde, 01/11/2016

http://www.lemonde.fr/actualite-medias/article/2016/11/01/facebook-faux-ami-de-la-democratie_5023701_3236.html - Les sombres héros de la Data, Stéphane Favereaux, Comm des mots, 12/09/2016

http://comm-des-mots.fr/2016/09/un-autre-jour-sur-internet/ - La data, nouvelle drogue du créatif, Guillaume de Roquemaurel, Stratégies, 25/04/2016

http://www.strategies.fr/blogs-opinions/idees-tribunes/1038964W/la-data-nouvelle-drogue-du-creatif.html - Media’s Next Challenge: Overcoming the Threat of Fake News, Jim Rutenberg, New York Times, 6/11/2016

https://www.nytimes.com/2016/11/07/business/media/medias-next-challenge-overcoming-the-threat-of-fake-news.html?_r=2 - How Bots Will Completely Kill Websites and Mobile Apps, Matt Schlicht, Chatbotsmagazine, 02/11/2016

https://chatbotsmagazine.com/how-bots-will-completely-kill-websites-and-mobile-apps-656db8e6fc03#.3vho1xsqx - Facebook’s Filter Bubble Is Getting Worse, Federico Nejrotti, Motherboard – Vice, 01/07/2016

http://motherboard.vice.com/read/facebooks-filter-bubble - EscapeYourBubble Shows You Stories From Outside Your Echo Chamber, Eric Ravenscraft, Lifehacker, 24/11/2016

http://lifehacker.com/escapeyourbubble-shows-you-stories-from-outside-your-ec-1789327491?utm_medium=sharefromsite&utm_source=Lifehacker_twitter - The filter bubble isn’t just Facebook’s fault – it’s yours, Philip Seargeant et Caroline Tagg, The Conversation 5/12/2016

https://theconversation.com/the-filter-bubble-isnt-just-facebooks-fault-its-yours-69664 - Bulle de filtre et désinformation : Facebook, une entreprise politique ?, Hubert Guillaud, Internet Actu, 22/11/2016

http://www.internetactu.net/2016/11/22/bulle-de-filtre-et-desinformation-facebook-une-entreprise-politique/